SEO KPI와 GEO KPI를 따로 보면 안 되는 이유 - 한 대시보드로 묶는 법

SEO 팀은 클릭과 순위를 보고, GEO 팀은 인용과 점유율을 봅니다. 문제는 이 둘이 따로 나오면 결국 같은 질문이 반복된다는 점입니다.

“그래서 지금 검색 성과가 좋아진 건가요, 나빠진 건가요?”

이 질문에 답하려면 SEO 대시보드와 GEO 대시보드를 따로 두는 방식부터 바꿔야 합니다. 검색이 링크 중심에서 답변·인용·추천 중심으로 넓어졌다면, 리포트도 그 변화에 맞게 넓어져야 하기 때문입니다.

핵심은 SEO KPI를 버리고 GEO KPI로 갈아타는 것이 아닙니다. 반대로 GEO KPI를 SEO 리포트 아래에 대충 덧붙이는 것도 답이 아닙니다. 필요한 건 클릭, 인용, 어떤 페이지가 실제로 쓰였는지, 브랜드 수요를 한 화면에서 연결해 보는 운영 프레임입니다.

이 글에서는 그 프레임을 실무 기준으로 정리합니다. Google Search Console, Bing Webmaster Tools, Semrush, Ahrefs, Profound처럼 서로 다른 성격의 지표를 어떻게 같은 보고서에 넣고, 어떤 순서로 읽고, 누가 책임져야 하는지까지 같이 보겠습니다.

1. 왜 따로 보면 계속 판단이 엇갈릴까요?

Google Search Console은 여전히 SEO의 기준점입니다. Google 도움말 문서 기준으로 Search Console 성과 보고서(Performance report)는 클릭, 노출, CTR, 평균 순위를 기본 축으로 제공하고, 검색어(query), 페이지(page), 국가(country), 기기(device), 검색 화면(search appearance), 날짜(date) 단위로 나눠 볼 수 있습니다.

문제는 이 데이터만으로는 AI 답변 안에서의 가시성이 거의 보이지 않는다는 점입니다. 반대로 Bing Webmaster Tools의 AI Performance는 2026년 2월부터 Total Citations, Average Cited Pages, Grounding Queries, Page-level citation activity를 보여주기 시작했지만, 이 역시 전통적인 검색 수요와 클릭을 설명하지는 못합니다.

즉, 한쪽만 보면 계속 오판합니다.

SEO 지표만 보면 AI가 브랜드를 자주 언급해도 성과를 놓치기 쉽습니다.

GEO 지표만 보면 citations는 늘었는데 실제 검색 수요나 전환이 따라오지 않는 상황을 놓치기 쉽습니다.

경영진은 “검색이 줄었다” 혹은 “AI 노출이 늘었다” 같은 단편적 결론만 듣게 됩니다.

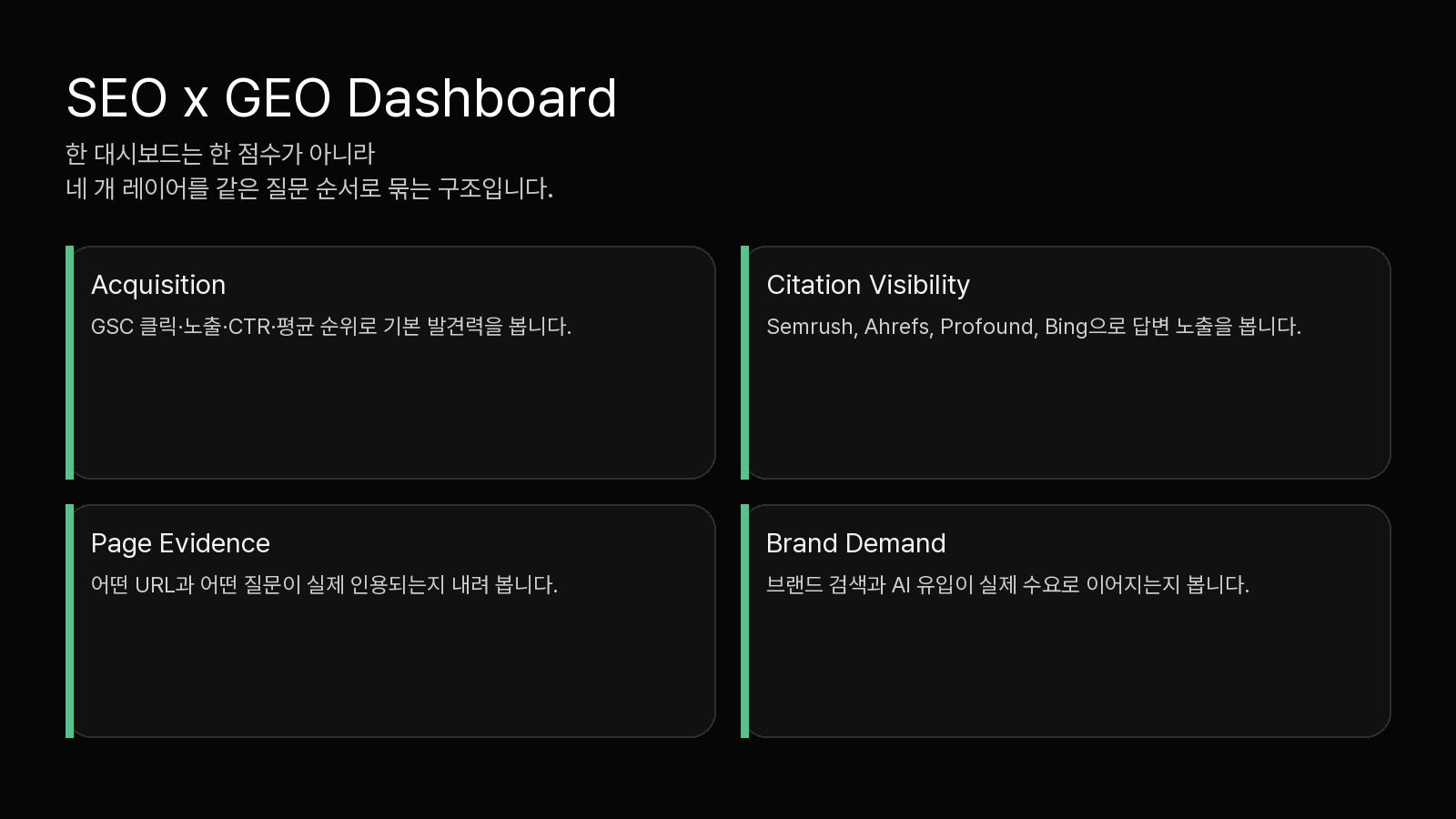

그래서 필요한 건 모든 걸 억지로 합친 하나의 점수가 아니라, 성격이 다른 지표를 같은 맥락에서 읽는 대시보드입니다.

좋은 통합 대시보드는 클릭과 인용을 섞어버리지 않고, 검색 유입·AI 인용 노출·인용된 페이지 근거·브랜드 수요 네 층으로 나눠 보여줍니다.

Ahrefs도 GEO를 별도 성장 전략과 지표 주제로 다루고 있습니다. 출처: Ahrefs, Generative Engine Optimization.

2. 대시보드는 네 층으로 나눠야 덜 헷갈립니다

레이어 | 핵심 질문 | 대표 지표 | 주요 데이터 소스 |

|---|---|---|---|

검색 유입 | 검색엔진에서 여전히 발견되고 있는가? | Clicks, Impressions, CTR, Avg Position | Google Search Console |

AI 인용 노출 | AI 답변 안에서 얼마나 자주 언급·인용되는가? | Total Citations, Mentions, AI Visibility Score, AI SOV, Visibility Score | Bing, Semrush, Ahrefs, Profound |

인용된 페이지 근거 | 어떤 페이지와 어떤 질문이 실제로 쓰이고 있는가? | Page-level citations, Grounding Queries, AI citations by URL, prompt-level citations | Bing, Ahrefs, Profound |

브랜드 수요 | AI 노출이 브랜드 수요와 방문으로 이어지는가? | Branded search demand, monthly audience, AI referral sessions, assisted conversions | Ahrefs, Semrush, analytics stack |

이 구조의 장점은 명확합니다. SEO와 GEO를 경쟁 관계로 보지 않고, 각 지표가 어디를 설명하는지 역할을 분리할 수 있습니다.

3. 각 층에는 어떤 숫자를 넣어야 할까요?

1층은 검색 유입입니다: Search Console을 기준선으로 둡니다

Search Console Performance Report는 여전히 첫 줄에 있어야 합니다. 클릭, 노출, CTR, 평균 순위는 “검색엔진에서 발견되는 힘”을 가장 안정적으로 보여주는 기준선이기 때문입니다.

Google 도움말 기준으로 성과 보고서는 검색어, 페이지, 국가, 기기, 검색 화면, 날짜 기준으로 쪼개 볼 수 있고, Web/Image/Video/News 타입도 나눠 볼 수 있습니다. 실무 대시보드에서는 최소 아래 항목을 넣는 편이 좋습니다.

비브랜드 클릭

비브랜드 노출

핵심 페이지군 CTR

상위 20개 검색어 묶음의 평균 순위

여기서 중요한 건 GEO 지표와 섞지 않는 것입니다. Search Console은 검색 수요를 클릭으로 설명하는 레이어라고 선을 긋는 편이 좋습니다.

2층은 AI 인용 노출입니다: 얼마나 자주 언급됐는지 봅니다

AI 답변 성과는 클릭보다 먼저 보였는가와 언급됐는가를 봐야 합니다. 이 레이어에서 각 툴은 조금씩 다른 각도를 제공합니다.

Bing AI Performance: Total Citations, Average Cited Pages, citation trend

Semrush: AI Visibility Score, Mentions, Monthly Audience, share of voice

Ahrefs: Mentions, Impressions, AI Share of Voice

Profound: Visibility Score, Share of Voice

Semrush는 AI Visibility Score를 0~100 점수로 제공하고, 공식 KB에서 이 점수가 Topic Coverage와 Mention Consistency를 결합해 계산된다고 설명합니다. Ahrefs는 Mentions, Impressions, AI Share of Voice를 함께 보여주며, 특히 Impressions를 Google search volume으로 가중한 노출 추정치로 정의합니다. Profound는 Visibility Score를 “추적 중인 답변 중 브랜드가 등장한 비율”, Share of Voice를 “전체 브랜드 멘션 중 우리 브랜드 멘션 비율”로 설명합니다.

같은 대시보드에 이 숫자를 넣을 때는 하나로 합쳐 평균내지 말고, 브랜드 가시성 묶음으로 묶는 게 낫습니다. 기준이 서로 다르기 때문입니다.

3층은 근거 페이지입니다: 어떤 페이지가 실제로 쓰였는지 봅니다

경영진 리포트에서 가장 자주 빠지는 게 이 레이어입니다. citations가 늘었다는 말만 있고, 어떤 URL이 왜 인용됐는지가 빠져버리기 때문입니다.

Bing의 AI Performance는 이 부분을 꽤 직접적으로 해결합니다. 공식 발표 기준으로 Grounding Queries는 AI가 콘텐츠를 가져올 때 사용한 핵심 질문 샘플을 보여주고, Page-level citation activity는 어떤 URL이 얼마나 자주 인용됐는지 보여줍니다.

Ahrefs는 Site Explorer에서 AI citations를 통해 어떤 페이지가 AI 응답의 출처로 들어갔는지 빠르게 볼 수 있다고 설명합니다. Profound는 Prompt Driven Analysis를 통해 매일 답변형 검색 환경에 보낸 프롬프트와 응답 데이터를 바탕으로 페이지·브랜드 사용 패턴을 걸러 볼 수 있다고 설명합니다.

실무에서는 이 레이어가 가장 액션과 가깝습니다. 어떤 페이지를 보강할지, 어떤 FAQ를 추가할지, 어떤 비교표가 부족한지까지 여기서 내려옵니다.

Search OS 같은 운영 도구가 유의미해지는 것도 이 구간입니다. 점수 자체보다, 어떤 URL이 어떤 질문군에서 빠지고 있는지까지 내려가야 수정 우선순위를 잡을 수 있기 때문입니다.

4층은 브랜드 수요입니다: AI 노출이 다시 검색과 전환으로 이어졌는지 봅니다

GEO 보고서가 공허해지는 지점은 여기입니다. mentions와 citations는 늘었는데 브랜드 검색과 세션이 전혀 반응하지 않으면, 경영진은 곧바로 “그래서 매출이랑 무슨 상관이냐”를 묻게 됩니다.

Ahrefs는 GEO 가이드에서 브랜드 검색량을 AI 인용과 함께 볼 신호로 권합니다. Semrush는 AI mentions가 쌓이면 브랜드에 대한 호기심이 생겨 브랜드 검색량과 검색 노출로 이어질 수 있다고 설명합니다. 이 두 신호를 같이 보면 “AI 안에서 보인 뒤, 사람이 다시 우리를 찾는가”를 추적하기 쉬워집니다.

여기에 실무적으로는 아래 지표를 붙이면 좋습니다. 이 부분은 여러 소스를 엮은 운영 권장안입니다.

브랜드명 포함 query 클릭/노출 추이

AI 유입 세션 추이

AI 유입 랜딩 페이지별 참여도

브랜드 검색 이후 전환율

즉, GEO의 결과를 결국 브랜드 수요와 보조 전환 지표로 내려 연결해줘야 합니다.

4. 한 화면에는 이렇게 배치하면 됩니다

많은 팀이 대시보드를 “지표 목록”으로 만듭니다. 하지만 잘 읽히는 대시보드는 질문 순서로 배치합니다. 저는 아래 순서를 추천합니다.

섹션 | 맨 위에 놓을 질문 | 들어갈 지표 |

|---|---|---|

1. 검색 기준선 | 검색엔진에서 기본 발견력이 유지되는가? | GSC 클릭, 노출, CTR, 순위 |

2. AI 가시성 | AI가 우리를 얼마나 자주 언급하는가? | Semrush AI Visibility Score, Ahrefs Mentions/Impressions, Profound Visibility Score, AI SOV |

3. 인용 근거 | 어떤 페이지와 질문이 실제 인용되는가? | Bing citations, grounding queries, page-level citation activity, Ahrefs AI citations |

4. 비즈니스 신호 | 브랜드 수요와 방문 품질이 같이 움직이는가? | Branded demand, AI referral sessions, assisted conversions |

이 순서는 이유가 있습니다. 경영진은 보통 “검색이 유지되나?”, “AI에서 보이나?”, “무슨 페이지가 먹히나?”, “비즈니스로 이어지나?” 순서로 묻습니다. 대시보드도 그 순서로 읽혀야 합니다.

5. 숫자 하나만 봐야 한다면 무엇을 볼까요?

솔직히 말하면 SEO와 GEO를 완벽하게 하나의 숫자로 합치는 건 무리입니다. 계산 방식이 다르고, 설명하는 행동도 다르기 때문입니다.

그래도 경영진이 하나만 달라고 하면, 저는 단일 지표보다 두 개를 같이 보는 방식을 추천합니다.

비브랜드 검색 클릭: 검색 수요를 실제 방문으로 전환하는 힘

AI Share of Voice 또는 Visibility Score: AI 답변 안에서의 상대적 점유

이 두 숫자를 같이 보면 “클릭은 떨어졌지만 AI 점유가 늘어난 상태”와 “둘 다 내려가는 상태”를 구분할 수 있습니다. GEO가 확대될수록 클릭이 일부 줄어도 AI 가시성이 개선될 수 있기 때문에, 한 숫자만 보면 잘못된 판단을 하게 됩니다.

6. 주간과 월간은 같은 리듬으로 보면 안 됩니다

대시보드는 하나여도 읽는 운영 주기는 나눠야 합니다.

주간 운영 회의: 페이지별 인용 수, grounding queries, AI mentions 급증·급감, 상위 질문 묶음 변화

월간 리포트: GSC 기준선, AI 가시성 추이, 브랜드 검색 수요, AI 유입 품질

분기 리뷰: 주제 커버리지 빈틈, 경쟁사별 점유율, 콘텐츠 허브별 기여도, 구조 개선 우선순위

즉, 주간에는 액션 가능한 페이지와 질문을 보고, 월간에는 흐름을 보고, 분기에는 체계를 봐야 합니다.

7. Search OS가 필요한 이유는 리포트보다 운영에 있습니다

지표를 보는 일 자체보다 더 어려운 건, 지표를 수정 우선순위로 연결하는 일입니다. 어느 페이지가 인용을 잃고 있는지, 어떤 질문군에서 visibility score는 낮은데 브랜드 검색 수요는 올라가는지, 어느 템플릿에서 FAQ 구조를 먼저 손봐야 하는지 같은 문제는 결국 운영 레이어가 있어야 풀립니다.

Search OS가 필요한 지점도 여기입니다. Search OS는 SEO와 GEO를 따로 모니터링하는 도구라기보다, 질문 신호와 키워드 신호, 페이지 구조, 크롤링 가능성, 대규모 업데이트 우선순위를 한 흐름으로 연결하는 운영 소프트웨어에 가깝습니다. 리포트가 많아질수록 중요한 건 숫자 하나를 더 쌓는 게 아니라, 수정 작업이 어디로 가야 하는지 빨리 정하는 일이기 때문입니다.

특히 Search OS처럼 검색과 AI 가시성을 같이 보는 레이어가 있으면, 경영진 보고용 숫자와 실무 작업용 페이지 리스트를 분리하지 않고 이어서 볼 수 있습니다. 대시보드에서 끝나지 않고 실제 수정 backlog로 이어지는 구조가 만들어진다는 점이 중요합니다.

결국 Search OS 기준으로 필요한 팀은 숫자를 더 예쁘게 그리려는 팀이 아니라, 어떤 페이지를 먼저 고쳐야 할지 매주 결정해야 하는 팀입니다.

자주 묻는 질문

SEO KPI와 GEO KPI를 합쳐서 하나의 점수로 만들면 안 되나요?

가능은 하지만 권장하지 않습니다. 각 지표가 설명하는 행동이 다르기 때문에, 보통은 하나의 점수보다 4개 레이어 구조가 더 해석하기 쉽습니다.

GEO KPI에서 가장 먼저 볼 숫자는 무엇인가요?

초기에는 인용 수와 mentions를 먼저 보고, 그다음 share of voice와 페이지별 인용 현황으로 내려가는 편이 실무적으로 좋습니다.

클릭이 줄었는데 AI visibility가 늘면 성공인가요?

그럴 수 있습니다. 다만 브랜드 검색 수요, 유입 품질, 페이지별 인용 깊이까지 같이 봐야 진짜 개선인지 판단할 수 있습니다.

팀이 작으면 어떤 데이터 소스부터 붙이는 게 현실적일까요?

최소 조합은 Search Console + Bing AI Performance + 브랜드 검색어 모니터링입니다. 여기에 Semrush, Ahrefs, Profound 중 하나를 추가해 경쟁 비교 레이어를 보강하면 됩니다.

마지막으로 이것만 기억하세요

한 대시보드의 목적은 SEO와 GEO를 섞어버리는 데 있지 않습니다. 오히려 둘을 같은 사업 질문 아래에서 분리해 읽을 수 있게 만드는 것에 있습니다.

검색이 클릭 경쟁에서 답변 채택 경쟁까지 넓어졌다면, 리포트도 그만큼 넓어져야 합니다. 그 출발점은 단순합니다. 클릭, 인용, 페이지 증거, 브랜드 수요. 이 네 줄만 한 화면에 제대로 올려도 SEO와 GEO는 처음으로 같은 운영 언어를 갖기 시작합니다.

그리고 Search OS 관점에서는 그 다음 단계가 더 중요합니다. 네 줄을 보기 좋게 그리는 데서 끝나는 것이 아니라, 인용이 빠진 페이지를 고치고, 질문형 수요가 몰리는 주제를 확장하고, 크롤링 문제를 줄이는 작업까지 연결되어야 대시보드가 실제 성장 도구가 됩니다.

함께 읽으면 좋은 글

[SEO와 GEO 개념정리] 대규모 플랫폼을 위한 AI 검색 최적화 알아보기. 개념 별 차이점과 측정 방법

SEO와 GEO 지표를 왜 따로 보되 같이 읽어야 하는지 먼저 정리하고 싶다면 이 글이 출발점입니다.AI 검색(GEO) 상위노출 전략: 키워드 분석부터 스키마 마크업까지

대시보드에서 문제를 찾은 뒤 어떤 콘텐츠와 구조를 우선 고칠지 이어서 보기 좋습니다.GEO 플라이휠: AI 검색 지배를 위한 E-E-A-T, 스키마 통합 전략

지표를 운영 체계와 연결하는 방식까지 보고 싶다면 이 글을 같이 보시면 됩니다.

참고 자료

Google Search Console Help - How are you performing on Google?

Google Search Console Help - Performance report (Search results)

Bing Webmaster Blog - Introducing AI Performance in Bing Webmaster Tools Public Preview

Semrush - What Is Answer Engine Optimization? And How to Do It

Semrush KB - Where does the data in Semrush’s AI Visibility Toolkit come from?

Ahrefs - Generative Engine Optimization: Growth Strategies and Metrics For the AI Era